Derin Öğrenme (Deep Learning) Nedir?

Derin öğrenme, yapay zekânın bir alt kümesi olarak belirtilen makine öğreniminin bir alt kümesi olarak ifade edilmektedir. Makine öğrenimi, eğitilmiş bir dizi algoritmayı temsil etmektedir. Diğer yandan derin öğrenme, insan beyninin yapısından esinlenen bir makine öğrenimidir. Derin öğrenme algoritmaları, verileri belirli bir mantıksal yapı ile sürekli analiz ederek insanların yaptığı gibi benzer sonuçlar çıkarmaktadır. Bunu başarmak için ise sinir ağları denen çok katmanlı bir algoritma yapısını kullanmaktadır.

Yapay Sinir Ağı Nedir? Nasıl Çalışır?

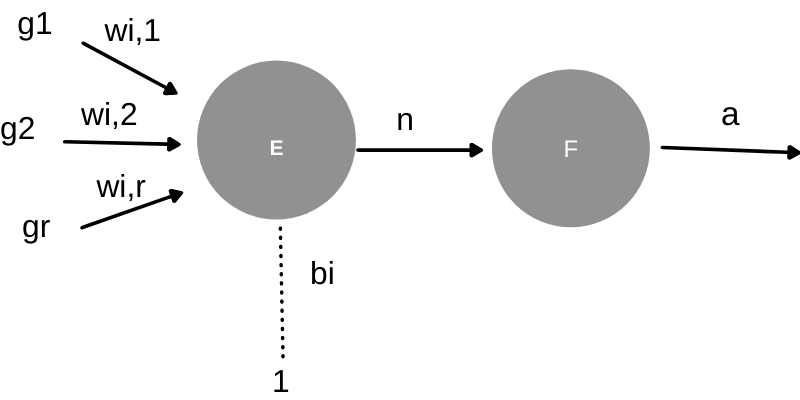

Yapay sinir ağı, insan beyninin çalışma prensibini taklit eden bir program ve veri yapı sistemidir. Sinir hücrelerinin (nöronlar) çeşitli şekillerde birbirine bağlanması ile ağ oluşturmaktadır. Bu ağlar; öğrenme, hafızaya alma ve veriler arasındaki ilişkiyi ortaya çıkarma gibi bazı kapasitelere sahiptir. Yapay sinir ağı, insan beynini yani insanın doğuştan sahip olduğu öğrenme yeteneğini modellemeye çalışmaktadır. Yapay sinir ağındaki her bir sinir, kendisine bir önceki sinirden gelen bilgiyi veri olarak alıp bir aktivasyon ya da transfer fonksiyonu ile işleme tabi tutmaktadır. Eğer varsa bias değeri ile toplayıp oluşan çıktıyı kendisinden sonra bağlı olduğu sinirler ile birlikte sinapatik ağırlıkları çarparak iletmektedir. Genellikle bu çıktı değeri, bundan sonraki sinirlere bir iletim olup olmayacağını belirleyerek bir eşik değeri ile karşılaştırmakta ve bu karşılaşma aktivasyon fonksiyonu tarafından belirlenmektedir. Bu ardışık işlemler süreci, en son çıktı katmanındaki çıktı değerlerinin elde edilmesine kadar sürdürülmektedir. Bir yapay sinir; kendisine gelen sinyalleri (g), geldikleri sinirlerden olan sinapatik bağlantıların ağırlıkları (wi) ile çarparak toplanmaktadır. Buna varsa bias terimini de (bi) ekleyerek elde edilen sonucu (n) tanımlanan aktivasyon fonksiyonuna (f) göndermektedir. Argümanı n olan aktivasyon fonksiyonu da skaler sinir çıktısı olan a değerini üretmektedir. Genel olarak herhangi bir ara katmandaki (saklı katman) inci yapay sinirin yapısı ve ve işlem akışı şeklinde görülmektedir.

Yukarıda verilen sigmoid tipli aktivasyon fonksiyonu türevi alınmakta ve bu, problem çözümünde kullanılmaktadır. Literatürde en çok ileri beslemeli sinir ağ yapıları kullanılır. İleri beslemeli yapay sinir ağında, hücreler katmanlar şeklinde düzenlenmekte ve bir katmandaki hücrelerin çıkışları bir sonraki katmana ağırlıklar üzerinden giriş olarak verilmektedir.

Neden “Derin Öğrenme“ Diyoruz? Neden Sadece “Yapay Sinir Ağları“ Değil?

Geoffrey Hinton, yapay sinir ağları alanında bir öncü bir kişiliktir. Hinton, çok katmanlı algılayıcı ağları eğitmek için geri yayılım algoritmasıyla ilgili makaleyi birlikte yayınlamıştır. Ayrıca büyük yapay sinir ağlarının gelişimini tanımlamak için “derin” ifadesini bizlere tanıtan ilk kişi olabilir. 2006 yılında, sınırlı Boltzmann makinelerinin “derinlemesine” eğitilmesine yönelik bir yaklaşımı tanımladıkları “ Derin İnanç Ağları için Hızlı Öğrenme Algoritması ” başlıklı bir makalenin de ortak yazarı olarak karşımıza çıkmaktadır. “ Birbirini tamamlayan öncülleri kullanarak en üstteki iki katmanın yönlendirilmemiş bir çağrışımsal bellek oluşturması koşuluyla derin ve yönlendirilmiş inanç ağlarını her seferinde bir katman olarak öğrenebilen hızlı ve açgözlü bir algoritma türetiyoruz. ” Bu makalenin ve Geoffrey’un ortak yazarı olan Hinton, yönetilmeyen derin bir ağ üzerine “Derin Boltzmann Makineleri” adlı makale, topluluk tarafından iyi karşılandı. Çünkü bunlar, ağların açgözlü katman bilge eğitiminin başarılı birer örnekleriydi. Science dergisindeki “Sinir Ağları ile Verilerin Boyutunu Azaltmak” adlı ortak yazarlı bir makalede ise daha önce tipik olandan çok daha fazla katmana sahip ağlar geliştirmeye yönelik yaklaşımlarını tanımlamak için aynı “derin” tanımına bağlı kaldılar. “ Derin otomatik kodlayıcı ağlarının, verilerin boyutluluğunu azaltmak için bir araç olarak temel bileşen analizinden çok daha iyi çalışan düşük boyutlu kodları öğrenmesine olanak tanıyan etkili bir şekilde ağırlıkları başlatmayı açıklıyoruz.”

Aynı makalede, Andrew Ng’nin son zamanlarda hesaplama gücündeki artış ve daha büyük ölçekte kullanıldığında sinir ağlarının kullanılmayan kapasitesini ortaya çıkaran büyük veri setlerine erişim hakkındaki yorumuyla örtüşen ilginç bir yorum yapıtılar. 1980’lerden beri, derin otomatik kodlayıcılar aracılığıyla geri yayılması, bilgisayarların yeterince hızlı olması, veri kümelerinin yeterince büyük olması ve başlangıç ağırlıklarının iyi bir çözüme yeterince yakın olması koşuluyla doğrusal olmayan boyutsallık azaltmada çok etkili olacağı açıktı. Artık üç koşul da yerine getirildi. 2016’da Royal Society ile yaptığı “Derin Öğrenme” başlıklı bir konuşmada Geoffrey, Deep Belief Networks’ün 2006’da derin öğrenmenin başlangıcı olduğunu ve bu yeni derin öğrenme dalgasının ilk başarılı uygulamasının 2009’da konuşma tanıma olduğunu ifade etti. Derin İnanç Ağlarını kullanarak Akustik Modelleme, en gelişmiş sonuçları elde etmektedir. Konuşma tanımayı ve sinir ağı topluluklarının dikkatini çeken sonuçlar, muhtemelen isim değişikliğine neden olan önceki sinir ağı tekniklerinde farklılaştırıcı olarak “derin” kullanımı oldu.

Kaynakça:

Görüntülenme Sayısı:

Cevher.org sitesinden daha fazla şey keşfedin

Subscribe to get the latest posts sent to your email.